AI對運算資源的極度渴求正在重塑基礎架構,業界也正努力解決電力、擴充性和效率等需求。這促使了大量投資湧入,以重新配置資料中心架構。問題的癥結在於創造智慧需要巨大的運算能力。隨著AI的複雜度每年都以幾個數量級的速度增加,資料中心必須快速擴充。從這個角度來看,需求的成長速度非常驚人,預計到2027年,AI工作負載所消耗的能源將超過阿根廷全國的用電量。

資料中心新格局 AI朝多樣化架構演進

AI正重新定義各種類型資料中心的架構:包括超大規模、現場部署、代管和邊緣。迄今為止,大部分的關注仍集中在超大規模業者之間的軍備競賽上。對於運算資源的指數級需求,正在創造出擁有超過1GW容量的現場AI叢集。麥肯錫預測,到2030年,歐洲和美國超過60%的AI工作負載將託管在超大規模基礎設施上。

資料中心必須能夠支援AI工作負載,例如訓練大型語言模型(LLM)。這涉及到設施設計與架構的全面調整。為支援密集運算的需求,每個機架的電力容量必須增加到200~300kW,同時導入相對應的強化冷卻解決方案。像GPU和TPU等專業硬體整合至系統中,並搭配擴充的儲存系統,以管理龐大的資料量。目前正在部署分散式架構,以便獨立管理和擴充硬體,讓不同的工作負載都能有效地使用資源。網路架構也需要更新,以處理AI特有的流量模式,否則AI叢集可能會陷入數位壅塞-處理能力將因資料瓶頸而癱瘓。

除了超大規模設施之外,AI也在推動分散式基礎架構的需求,以支援本機的資料處理。這需要專為邊緣工作負載所設計的資料中心-以較小的實體占用空間和較低的能源消耗下達到高效能。預計到2030年,隨著越來越多的處理轉移到邊緣,這個市場預計將超過1,600億美元。

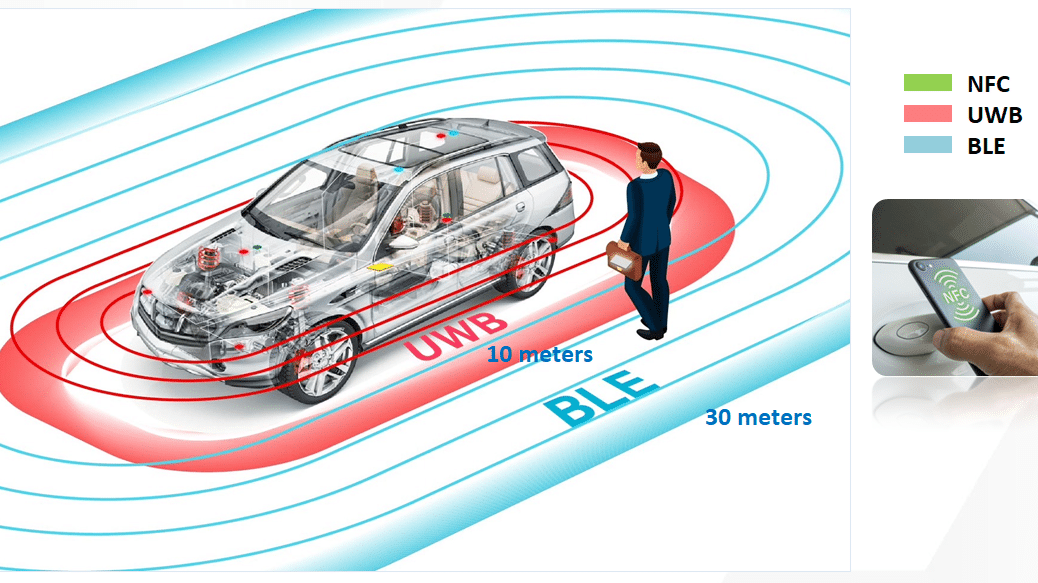

這種成長的動力來自於支援更接近終端使用者的即時處理,如自動駕駛等應用,在這些應用場景中,更快速的決策能力至關重要。這種方法可降低延遲,並支援由IoT和5G技術推動的超連結世界。

隨著AI應用的成熟,推論工作負載的成長速度遠高於模型訓練。基礎架構需要顧及這種從訓練到推理的轉變,像DeepSeek R1和OpenAI v3就是依賴於此種架構運作。這些推理系統利用經過訓練的模型來評估即時資料,有效率地進行預測或解決任務。

邊緣的連線裝置將會產生大量資料,因此相關設施需有足夠的規模來支援具有彈性資源分配的低延遲網路,以因應推理需求中不可預測的峰值。

利用AI擴充規模

矛盾的是,AI既是問題,也是解決方案。智慧對於解決擴充挑戰及確保有效運作至關重要。AI能以多種方式使資料中心現代化,包括:提高能源效率是永續經營的關鍵。部署AI可自動調整冷卻系統和伺服器工作負載,以滿足需求高峰。實施智慧節能技術有助於在維持效能的同時,降低浪費和營運成本;例如Google就成功將其資料中心的冷卻能耗降低了40%。

預測性維護則透過使用機器學習來預測潛在問題,這可將停機時間降至最低,並有助於延長基礎設備的使用壽命。由於擴充所涉及的規模與成本,能夠主動排程維修與更新以最佳化資源利用率,將具有實質的影響。

使用AI擴充的數位分身技術可建立動態模型,以測試和驗證元件與系統。這些解決方案能確保複雜的資料中心具有穩健性與彈性,並能支援未來的需求。AI演算法會分析效能與環境條件的歷史資料,提供洞察以最佳化作業。解決方案也可使用AI工作負載模擬網路效能,找出並修復潛在瓶頸。先進的測試與模擬工具是建立可擴充、有效率且可靠的基礎架構的重點。

AI將加速邁向完全自主的智慧型資料中心,這些資料中心幾乎可處理所有的作業,從監控、維護、網路到能源管理與安全。

未來的AI基礎架構

隨著AI的成熟,資料中心必須能容納日益複雜的工作負載。營運商正迫切希望以永續的方式擴充基礎架構,以支援不斷成長的需求,同時不犧牲效能與可靠性。由於目前大部分的AI藍圖仍不明朗,因此建立可適應的彈性與具韌性的基礎架構至關重要。

平衡超大規模運算能力與AI系統協調下的邊緣敏捷性的能力,將是決定成敗的關鍵。那些能夠擁抱這個現實的供應商將會在AI革命中脫穎而出。

(本文作者為是德科技Keysight資深副總裁)